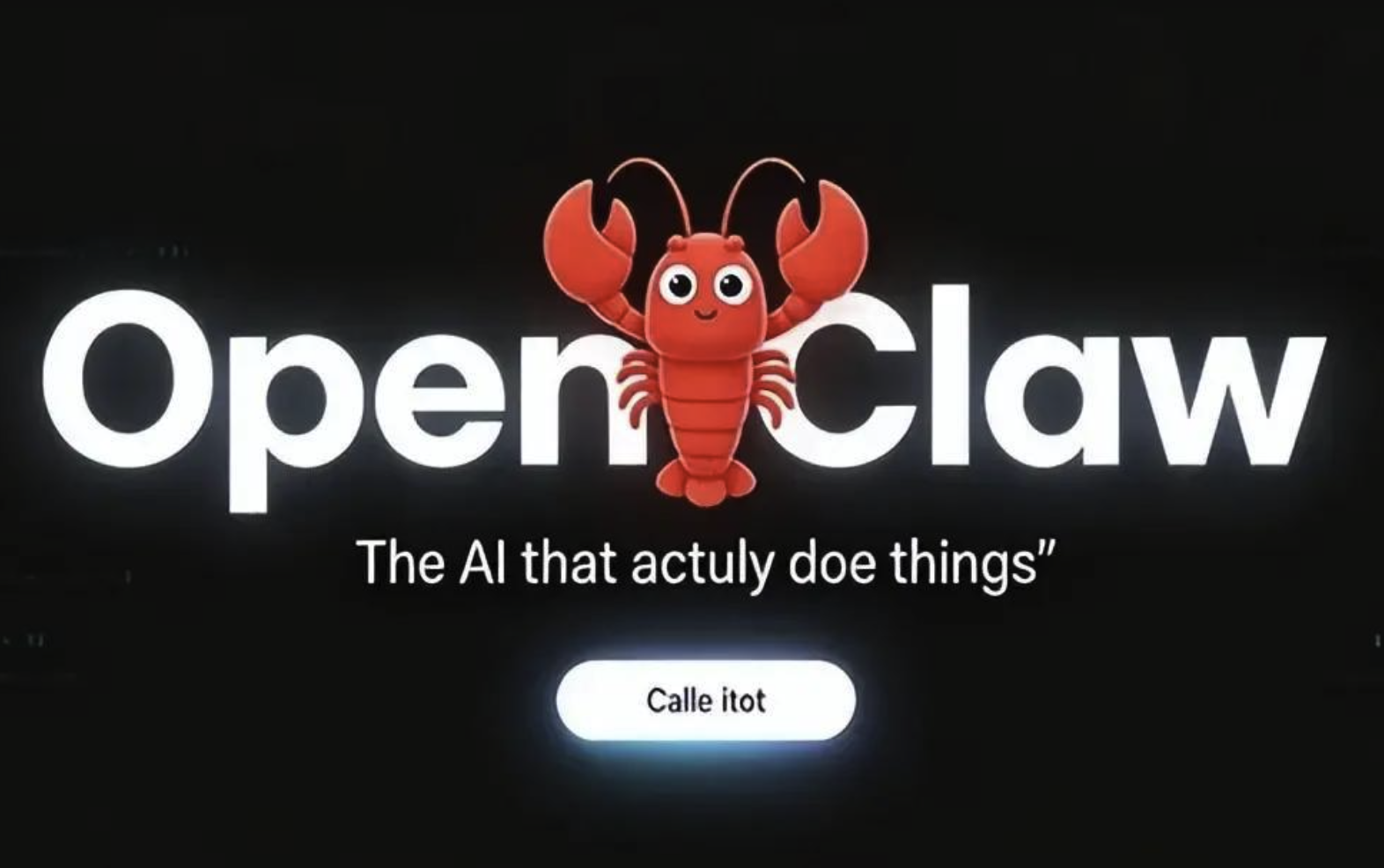

“龙虾”长眼睛了,智谱赋予OpenClaw视觉能力

如果你在过去一个月里关注过科技圈,一定听说过"养龙虾"这个词。成千上万的开发者和极客们在电脑上部署OpenClaw,让这只"数字龙虾"替自己自动填表、订机票、写报告——但有一个问题始终困扰着所有人:这只龙虾是"盲"的。

它只能通过程序接口"听"别人的指令做事,遇到没有接口的老软件,它就彻底抓瞎,像个被蒙住双眼的助手,只能站在原地干着急。

2026年4月2日,智谱给这只龙虾做了一场"开眼手术"。随着原生多模态模型GLM-5V-Turbo的正式发布,OpenClaw第一次拥有了真正的视觉皮层——它能像人一样"看"屏幕了。

以前的OpenClaw依赖API或代码解析,别人告诉它"按钮在坐标(120, 340)",它才能点下去。现在,它直接读取屏幕上的每一个像素,理解哪里是输入框、哪里是按钮、哪里是弹窗,然后自己判断该做什么。

你可以把它想象成一位一直蒙着眼睛的助手突然摘下了眼罩:面对一个老旧报销系统,以前它只能无奈地摊手说"这个软件没有接口",现在它看一眼页面,就能认出"报销金额""事由"这些框,自动帮你填好并提交。

更妙的是,它甚至能分析设计图——你给它一张UI稿,它会指出"这里按钮颜色和背景太接近,用户可能找不到";你截一张视频会议的图,它能从画面中提取"下周二前交报告"的文字,自动帮你添加到待办清单。

这种"像素级视觉映射"能力,让OpenClaw的操作范围从"支持API的应用"扩展到了你能在屏幕上看到的任何东西——老旧软件、专业设计工具、网页、图片、视频,统统不在话下。而且它不只"看",还"动":识别出界面元素后,它能输出精确的操作坐标,像人的手指一样点击、拖动、打字。

智谱方面表示,OpenClaw还可以集成GPT-5.4、Kimi等第三方视觉模型,进一步强化对复杂视频和真实场景的理解。有开发者已经在尝试把OpenClaw与Meta智能眼镜结合,让这只"龙虾"戴上眼镜后实时识别周围环境——看到一张海报就自动搜索购票链接,看到一份菜单就帮忙记下热量。

当然,长眼睛的龙虾也带来了新的担忧。因为它需要屏幕录制、文件读取等高权限,一旦被恶意利用,隐私风险不容小觑。智谱建议用户在沙箱或虚拟机中运行OpenClaw,同时提醒社区警惕第三方恶意技能。

但无论如何,这一天注定被记住:当那只勤勤恳恳却一直蒙着眼睛的"数字打工虾"终于睁开眼睛,AI Agent的进化史悄然翻开了新的一页。